چطور بفهمیم یک ویدیو یا عکس، واقعی است یا ساختهشده با هوش مصنوعی؟ + آموزش

به گزارش شهرآرانیوز؛ ویدیوهای تولیدشده با هوش مصنوعی همهجا دیده میشوند؛ از دیپفیک چهرههای مشهور و گزارشهای ساختگی از بلایای طبیعی گرفته تا ویدیوهای خرگوشهایی روی ترامپولین! ابزار تولید ویدیو با هوش مصنوعی «Sora» از شرکت مادر ChatGPT، یعنی OpenAI، تشخیص واقعیت از جعل را از همیشه سختتر کرده است. اکنون نسخهی جدیدتر این فناوری، یعنی Sora ۲، که در قالب یک اپلیکیشن شبکه اجتماعی عرضه شده، هر روز پیشرفتهتر میشود.

در چند ماه گذشته، این اپ شبیه تیکتاک بهسرعت وایرال شده و علاقهمندان هوش مصنوعی با شور و اشتیاق در جستوجوی «کد دعوت» برای ورود به آن هستند. اما Sora مثل هیچ شبکه اجتماعی دیگری نیست: هر آنچه در آن میبینید ساختگی است، و تمام ویدیوها بهطور کامل توسط هوش مصنوعی تولید شدهاند.

از دید فنی، ویدیوهای تولیدشده با Sora در مقایسه با رقبایی مانند Midjourney’s V۱ و Google’s Veo ۳ بسیار چشمگیرند؛ وضوح بالایی دارند، صدا و تصویرشان هماهنگ است و خلاقیت شگفتانگیزی در آنها دیده میشود. محبوبترین ویژگی Sora، قابلیتی به نام Cameo است که به کاربران اجازه میدهد چهرهی افراد دیگر را در هر صحنهی تولیدشده با هوش مصنوعی قرار دهند — ابزاری حیرتانگیز که نتیجهاش ویدیوهایی است بهطرز ترسناکی واقعی.

همین موضوع باعث نگرانی بسیاری از کارشناسان شده است. این اپ ساخت دیپفیکهای خطرناک، گسترش اطلاعات نادرست و محو شدن مرز میان واقعیت و خیال را آسانتر از همیشه کرده است. شخصیتهای عمومی و سلبریتیها بیش از دیگران در معرض این نوع جعلها هستند، و اتحادیههایی مانند SAG-AFTRA از OpenAI خواستهاند تا اقدامات محافظتی خود را تقویت کند.

تشخیص محتوای تولیدشده با هوش مصنوعی هنوز چالشی جدی برای شرکتهای فناوری، شبکههای اجتماعی و کاربران است، اما کاملاً غیرممکن هم نیست. در ادامه چند نشانه را معرفی میکنیم که میتوانند به شما در تشخیص ویدیوهای ساختهشده با Sora کمک کنند:

به دنبال واترمارک Sora باشید

هر ویدیویی که در اپ Sora ساخته میشود، هنگام دانلود، یک واترمارک دارد: لوگوی سفیدرنگ Sora (آیکونی به شکل ابر) که دور تا دور ویدیو در حال حرکت است: مشابه واترمارکهایی که در ویدیوهای تیکتاک میبینید.

واترمارک یکی از مؤثرترین روشها برای شناسایی محتوای تولیدشده با هوش مصنوعی است. برای مثال، مدل تصویری گوگل به نام Gemini nano banana نیز بهطور خودکار روی تصاویرش واترمارک درج میکند. وجود واترمارک نشانهای واضح از آن است که محتوا با کمک هوش مصنوعی تولید شده است.

اگر واترمارک ثابت باشد (حرکت نکند)، بهراحتی میتوان آن را برید یا حذف کرد. حتی واترمارکهای متحرک مانند واترمارک Sora نیز با اپلیکیشنهای مخصوص حذف واترمارک قابل پاکسازی هستند؛ بنابراین واترمارک بهتنهایی نمیتواند ملاک قطعی باشد.

وقتی از سم آلتمن، مدیرعامل OpenAI، درباره این موضوع سؤال شد، گفت: «جامعه باید خود را با جهانی وفق دهد که در آن هرکسی بتواند ویدیویی جعلی از هر فردی بسازد.»

پیش از عرضهی Sora، ابزاری در دسترس عموم و به این سادگی برای ساخت چنین ویدیوهایی وجود نداشت. با این حال، گفتهی او بهدرستی بر لزوم استفاده از روشهای دیگر برای تأیید اصالت محتوا تأکید دارد.

متادیتای فایلها را بررسی کنید

شاید فکر کنید «هیچوقت قرار نیست برای بررسی اصالت یک ویدیو وارد متادیتای فایل شوید»، اما این کار سادهتر از چیزی است که به نظر میرسد و یکی از بهترین روشها برای تشخیص ویدیوهای ساختهشده با Sora است.

متادیتا (Metadata) مجموعهای از اطلاعات است که هنگام ساخت هر محتوایی (عکس، ویدیو، سند و غیره) بهصورت خودکار ذخیره میشود. این دادهها اطلاعاتی مانند نوع دوربین، مکان، تاریخ، زمان ضبط و حتی نام فایل را دربر میگیرند. محتوای تولیدشده با هوش مصنوعی نیز متادیتا دارد، و اغلب در آن مشخص میشود که توسط هوش مصنوعی ساخته شده است.

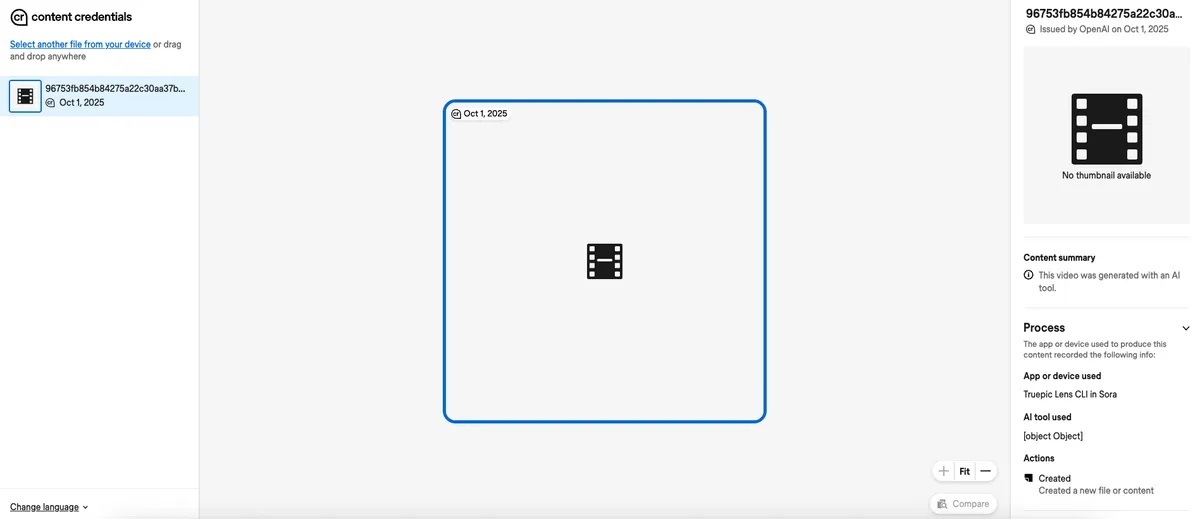

OpenAI عضوی از ائتلاف C۲PA (Coalition for Content Provenance and Authenticity) است، به همین دلیل ویدیوهای ساختهشده با Sora شامل متادیتای C۲PA هستند. برای بررسی متادیتا میتوانید از ابزار رسمی Content Authenticity Initiative استفاده کنید:

نحوه بررسی متادیتای ویدیو یا تصویر:

وارد این لینک شوید: https://verify.contentauthenticity.org/

فایل موردنظر را آپلود کنید.

روی Open کلیک کنید.

در بخش سمت راست اطلاعات را بررسی کنید. اگر محتوای شما با هوش مصنوعی ساخته شده باشد، در قسمت Content Summary مشخص خواهد شد.

وقتی یک ویدیوی ساختهشده با Sora را از این ابزار عبور دهید، عبارت «issued by OpenAI» (منتشرشده توسط OpenAI) را نمایش میدهد و تأیید میکند که ویدیو با هوش مصنوعی ساخته شده است.

البته این ابزار نیز بینقص نیست. برخی ویدیوهای هوش مصنوعی ممکن است طوری پردازش شوند که سیگنالهای متادیتای خود را از دست بدهند. مثلاً ویدیوهای ساختهشده با Midjourney معمولاً شناسایی نمیشوند. حتی اگر ویدیوی Sora را از طریق اپهای دیگر (مثلاً حذف واترمارک) ذخیره کنید، ممکن است متادیتای آن پاک شود و ابزار نتواند تشخیص دهد که هوش مصنوعی آن را ساخته است.

به برچسبهای دیگر هوش مصنوعی توجه کنید یا خودتان اضافه کنید

در برخی شبکههای اجتماعی مانند اینستاگرام و فیسبوک (متعلق به شرکت متا)، سیستمهایی برای شناسایی و برچسبگذاری محتوای هوش مصنوعی وجود دارد. البته این سیستمها کامل نیستند، اما میتوانند کمک کنند تشخیص دهید که آیا یک پست توسط هوش مصنوعی تولید شده یا نه. تیکتاک و یوتیوب هم سیاستهای مشابهی دارند.

بااینحال، تنها راه مطمئن برای دانستن اینکه یک ویدیو با هوش مصنوعی ساخته شده یا نه، افشای آن از سوی خالق محتواست. بسیاری از پلتفرمها حالا گزینهای در تنظیمات خود دارند که کاربران میتوانند با آن پستهایشان را با برچسب «AI-generated» منتشر کنند. حتی درج یک توضیح ساده در کپشن نیز میتواند به شفافیت و اعتماد کمک کند.

در اپ Sora، شما میدانید که هیچچیز واقعی نیست؛ اما وقتی ویدیوهای تولیدشده را در شبکههای اجتماعی دیگر به اشتراک میگذارید، مسئولیت جمعی ماست که منبع آن را بهدرستی اعلام کنیم. هرچه مرز میان واقعیت و هوش مصنوعی کمرنگتر میشود، اهمیت صداقت و شفافیت بیشتر خواهد شد.

مهمتر از همه: هوشیار بمانید

هیچ روش قطعی و یکمرحلهای برای تشخیص واقعی یا جعلیبودن یک ویدیو وجود ندارد. بهترین کاری که میتوانید انجام دهید، این است که هرآنچه را در اینترنت میبینید، بیچونوچرا نپذیرید. به حس درونی خود اعتماد کنید: اگر چیزی غیرواقعی به نظر میرسد، احتمالاً همینطور است.

در این دورانِ پر از محتوای مصنوعی، بهترین دفاع شما دقت بیشتر است: ویدیوها را با نگاه موشکافانهتری ببینید، دنبال متنهای درهم، اشیای ناپدیدشونده و حرکتهای غیرطبیعی بگردید، و اگر گاهی فریب خوردید، خود را سرزنش نکنید؛ حتی کارشناسان نیز اشتباه میکنند.